其他几个帖子:

今天早上6点,Alpha Arena 第一赛季已经结束,大家有看吗?没有看的,我来给大家介绍一下

训练过大模型的都知道,大模型的核心训练任务其实是基于前文的上下文信息,预测下一个token(不一定是单字,也可以是词、字符片段)的出现概率分布,并通过优化让预测结果更贴合真实的语言规律,最终模型学会的是语言的序列逻辑和概率关联。

训练的核心是优化整个序列的预测概率,而非单独的下一个token,最终追求的是让模型生成的整段文本在概率上最贴合真实语料

举个超通俗的例子,看完立马懂:

假设模型学过海量中文语料,现在给它前文“今天我想去吃”,它要做的就是「猜下一个token的概率」。

第一步:

模型调出所有学过的、跟“今天我想去吃”衔接的语料,统计出后续最常出现的内容,形成概率排名:

火锅(概率35%)

烤肉(概率20%)

米饭(概率15%)

奶茶(概率10%)

……

甚至离谱的“飞机”(概率0.001%)也会有,只是概率极低。

第二步:

训练的核心就是让这个概率排名无限贴合人类真实的说话习惯。

如果模型一开始把“飞机”排到了10%,训练就会“惩罚”它,把错误概率调低,同时把“火锅、烤肉”这类合理答案的概率调高,反复迭代后,模型的预测就越来越“人话”。

第三步:

实际生成时,模型会基于这个概率分布选结果(可灵活调整:选概率最高的=最稳妥的回答,随机选高概率的=更有多样性的回答)。

而且模型不是只猜“下一个”就完事,它会把刚猜出来的结果加入前文,继续猜下一个:

“今天我想去吃火锅”→ 再猜下一个→“今天我想去吃火锅,顺便”→ 再猜→“今天我想去吃火锅,顺便喝杯饮料”……

像搭积木一样,靠逐次预测token,拼出完整的一句话、一段话。

预测逻辑是不是一下子就清晰了?

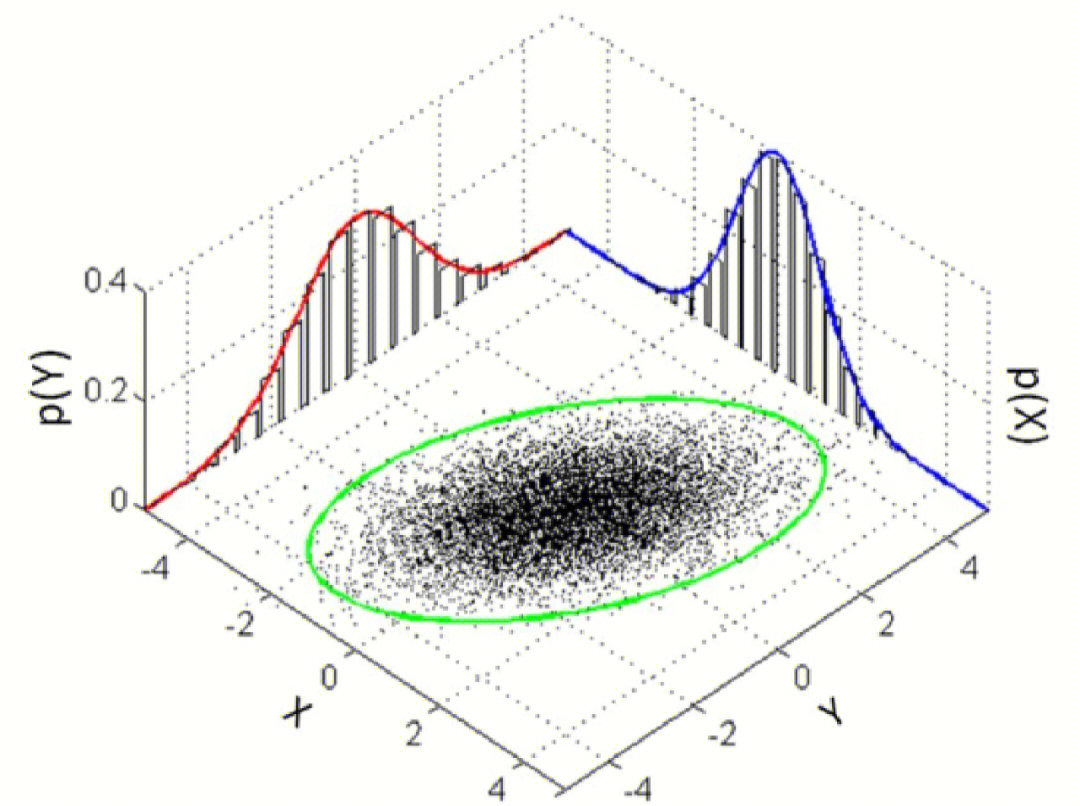

那么我们来思考一下,既然文字可以被训练后预测,那么股票可以预测吗?

文字前后的顺序是根据人进化中,不断创造和使用文字,不同的环境得到的结果,

股票是不是也是一样,根据整个世界的运行规律,国家的变化,社会的进化,历史的变革,突发的事件,人们的心理,最后反映在某些数值上,那么根据这些数值,是不是就可以大致推断出未来的走势

再往深了讲,人也是一样,人也可以量化,血脂血糖血压,体检时候的心率,静态脉搏,血氧含量,睡眠质量,胃口大小,每天走路的步数,积极或者消极的心态,慢性病痛,体重身高等等,都可以量化为十几个数值,用每天人的健康数值和寿命数值进行训练,就可以大致计算人的寿命。只是这些数值都是个人隐私,无法获取罢了。

国家应该也是一样的,只是更加复杂参数更多。

为什么可能活在虚拟世界中

因为这些数值是真实存在的,未来可以被预测的,换种说法就是命运已定,除非你改变了某个重要的参数,比如,你体重200斤,突发奇想开始减肥,比如你突然不抽烟了,比如突然开始赌博了,就是改变了重要的参数,那么模型就要重新开始训练,会得到一个不同的结果,但是一般不会,身体不会允许你做出重大改变,突破舒适区很难。

回过头来,如果需要达到辅助投资的功能,那么就需要很多资料,对整个投资环境进行数值量化。从鲍尔威的讲话到美储联的ZC,从华尔街的解读到市场期预”,A-I对Key的分析、上下文的判断,已经进入超级快速、准确、精炼的Level,普通人根本无法与之对抗,只能作为韭菜被割,我们要做的就是在被割的韭菜中,被割的最少,最好还能逃过被割,运气好点再把镰刀咬一口。

2026年购买所有历史数据喂给模型,期待训练一个专精模型

有想一起加入众筹的小伙伴吗?来AI兴趣小组群